陈博远的一条推文还泄漏,从客岁12月底的GPT Image 1.5算起,只用了四个月就有如斯大年夜的改进。

如许冲破性的成果,核心团队只有13人。

全部团队的负责人Gabriel Goh晒出了的团队成员AI全家福。

评论区有网友感慨:怎么满是亚洲人?

陈博远:从不懂Python到Research Lead

GPT Image 2毕竟是什么架构?

OpenAI生怕很长一段时光都不会颁布了,但从核心团队成员的学术经历可以看出一些陈迹。

陈博远是团队的Research Lead,他和另一位成员Kiwhan Song在MIT读博时有同一位导师Vincent Sitzmann。

从2019年参加OpenAI,他的早期研究更篇理论,专注于可解释性和凸优化等等。

这项研究提出Diffusion Forcing这一全新序列生成练习范式,将逐token自力噪声级扩散与因果下一个token猜测结合,融合自回归模型的可变长度生成与全序列扩散模型的长程引导优势。

他在Google练习时代还以合营一作身份揭橥了SpatialVLM。

经由过程过主动构建互联网范围的3D空间推理 VQA 数据集(1000 万图像、20 亿 QA 对),为视觉说话模型付与定量 / 定性空间推理才能,可从单张 2D 图像输出米制距离、尺寸、方位等精确数值。

这项研究把思维链空间推理应用到了具身智能范畴。

在Google练习时代,他开辟的指令微调技巧后续还被Gemini 2.0采取。

他在高中参加科研夏令营时,还不懂Python的根本语法,那时结识的GoogleDeepMind资深研究员夏斐把他引入了AI世界。

夏斐两次邀请他到DeepMind完成高质量练习,这些经历使陈博远积聚了大年夜范围模型练习的工程经验,也为他懂得多模态体系的数据需求供给了宝贵视角。

在演示中,他给故乡无锡做了一张海报。然后为来自首尔的队友做韩文海报,为来自Bangladesh的队友做孟加拉语海报。每一张中的文字衬着都精准无误。

中科大年夜Jianfeng Wang:让生图AI懂得世界常识

中科大年夜博士卒业的Jianfeng Wang,在GPT Image 2团队负责的是另一个让人赞叹的才能:指令遵守和懂得世界。

旧模型画的永远时钟永远指向10:10,源于收集上的钟表告白图,几乎清一色都是10:10。

这是因为钟表厂商找心理学家做过实验,认为这有助于刺激花费者买表的意愿。

他让新模型画2:25、3:30、9:10、7:45,全部精准。

……

这只是开胃菜。

更多复杂的空间构造,苹果在中间、杯子在右边、书在上面、相机在左边、篮球鄙人面。模型全部精准履行。

博士卒业后,陈博远于2025年6月参加OpenAI,敏捷成为GPT图片生成五人核心成员之一,负责GPT图像生成模型的所有练习,同时也是Sora视频生成团队的一员。

在参加OpenAI 之前,他在微软工作近9年。在微软时代就与OpenAI团队在DALLE-3上有合作。

他在计算机视觉范畴揭橥了多篇学术论文,研究内容可能涵盖 图像分类、目标检测、语义瓜分、以及视觉表征进修 等偏向

世界常识懂得才能的大年夜幅晋升,对象的语义内容和功能构造 有精确的懂得

JianFeng Wang在演示视频结尾说到:GPT Image 2正在清除你的意图和模型产出之间的差距。

真正做到你想要什么,模型就给你什么。

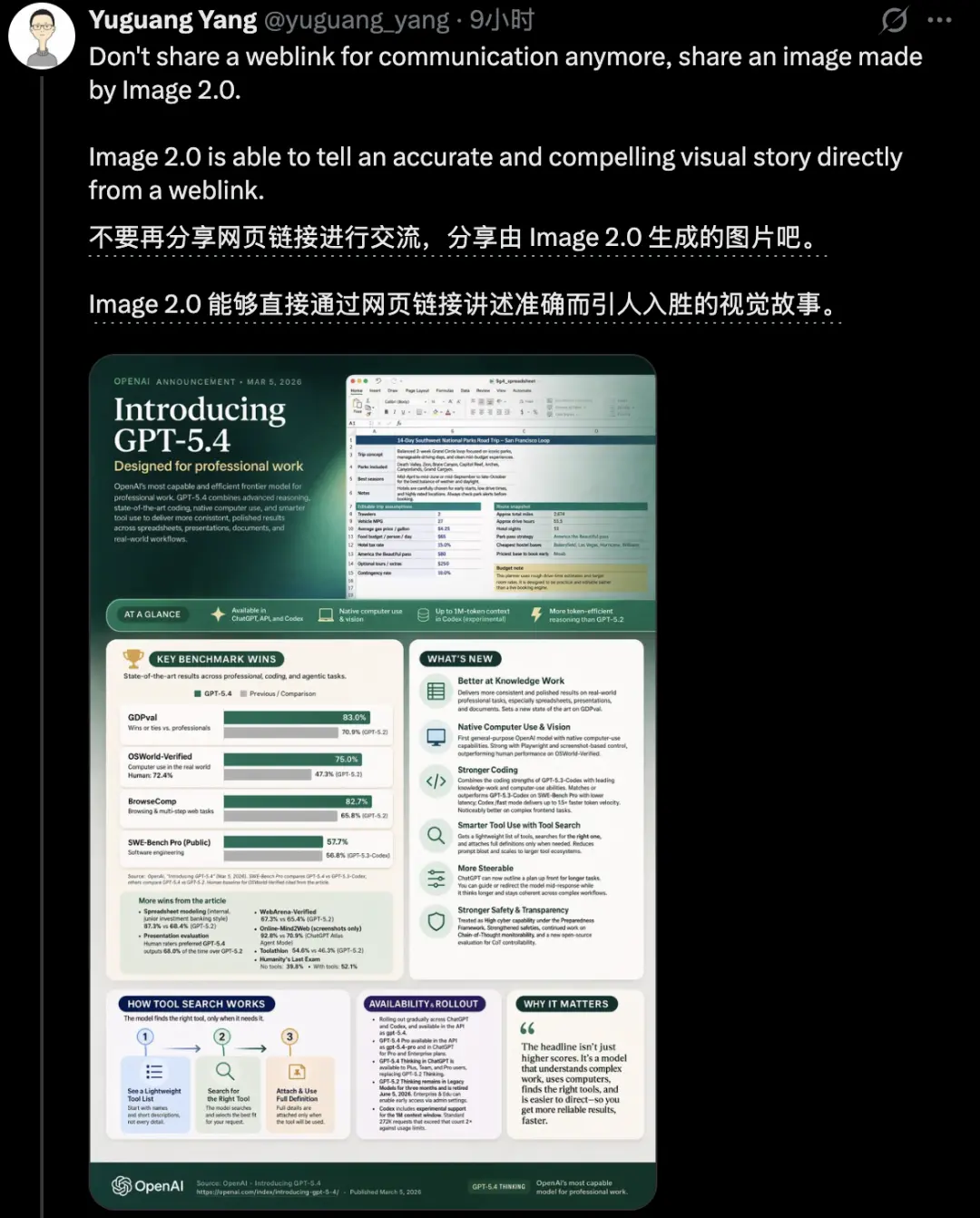

Yuguang Yang:生成高精度复杂信息图表

Yuguang Yang在GPT Image 2的宣布活动中演示了生成信息图和PPT。

整整75页的GPT-3论文拖进ChatGPT,主动生成7张幻灯片。

[1]https://x.com/gabeeegoooh/status/2046674385407512687?s=20

他的经历可以说是团队成员中最丰富的,每换一个工作都是跨界,但都聚焦机械进修。

他本科在浙大年夜竺可桢学院学的工程,博士在约翰斯霍普金斯大年夜学时代学的是计算化学物理与机械进修。

他第一份全职工作是量化分析师,在清华做拜访研究员时代亚牛的的是用于纳米机械人的强化进修和控制算法。

后来他在亚马逊做过Alexa语音研究。

又在微软做过Bing搜刮的查询懂得和检索、文档懂得。

2025岁首年代参加OpenAI后,除了图像生成还介入过ChatGPT智能体项目。

他在小我账号上介绍GPT Image 2的信息图生成才能,可认为科研人员节俭大年夜量时光。

还反复提示大年夜家,要做信息图不要忘记选择思虑模式。

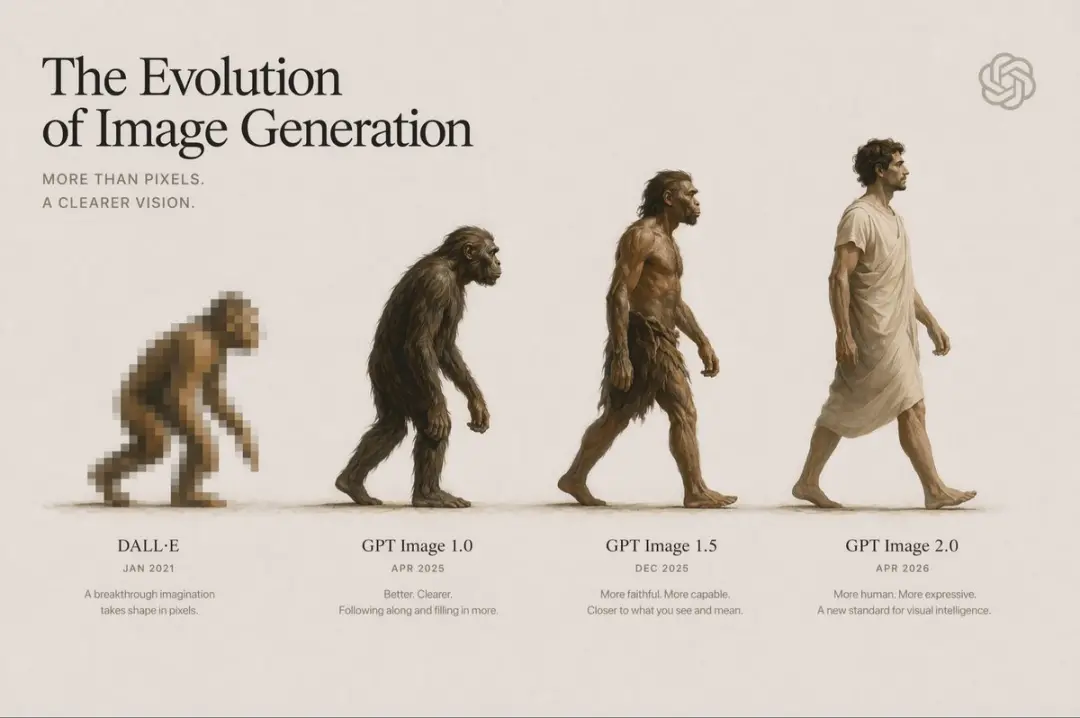

从DALL-E到GPT Image 2.0

从团队成员Kenji Hata的毛遂自荐中得知,GPT Image 1.0也就是GPT-4o的图像生成部分。

有一小我从DALL-E开端介入了OpenAI多模态系列研究的全程。

他就是GPT Image 2.0团队负责人Gabriel Goh。

从DALL-E开端慢慢转向了图像生成。

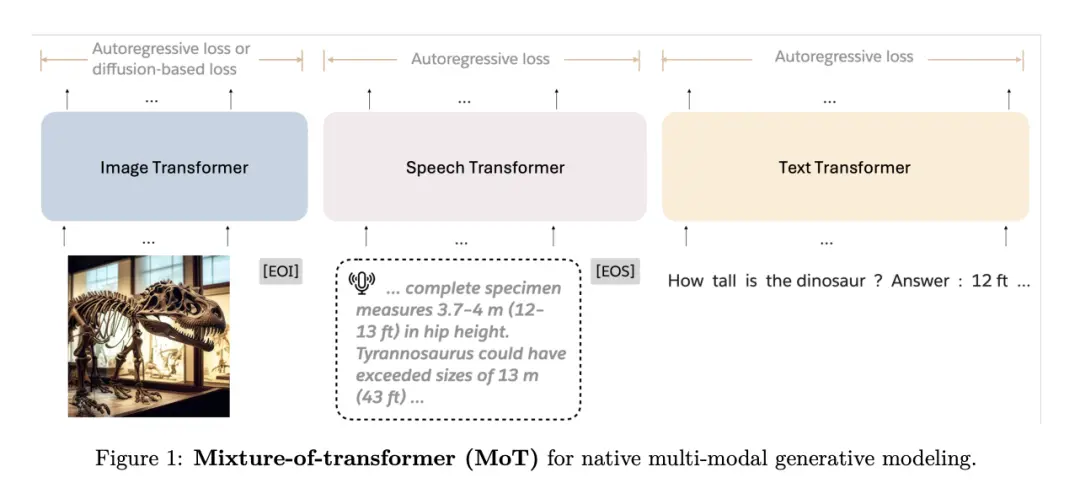

看到另一位团队成员Weixin Liang的研究经验,GPT Image 2的技巧底色又揭开了一角。

他在Meta练习时代的代表作Mixture-of-Transformers,引入模态解耦的MoE和解耦留意力,明显降低多模态模型预练习的计算成本。

他博士卒业自斯坦福,本科也卒业自浙大年夜竺可桢学院,不过比Yuguang Yang要晚好几年。

[2]https://venturebeat.com/technology/openais-chatgpt-images-2-0-is-here-and-it-does-multilingual-text-full-infographics-slides-maps-even-manga-seemingly-flawlessly

Weixin Liang与陈博远一样都是25年博士刚卒业就参加OpenAI,敏捷成为团队的核心成员。

他博士时代的代表作Diffusion Forcing: Next-token Prediction Meets Full-Sequence Diffusion入选了NeurIPS 2024。

其他GPT Image 2.0团队成员还包含:

Ayaan Haque,之前在Luma AI 工作,介入过Luma的视频生成基本模型Dream Machine的练习。

Bing Liang,在Google干了5年多,介入Imagen3、Veo、Gemini Multimodal,2025年跳到OpenAI做图像生成研究。

Mengchao Zhong,本科上海交通大年夜黉舍友,硕士卒业于得克萨斯农工大年夜学,在Pinterest和Airtable做过软件工程师,在OpenAI负责多模态产品的工程。

Dibya Bhattacharjee,耶鲁大年夜学,2015年IPhO铜牌,CIE A-Level数学和生物全球最高分。

Kiwhan Song是25年10月最晚参加的,除了做研究之外,他照样团队里的提示词大年夜师,大年夜家看到的官方演示图很多都出自他手。

从最早的DALL-E到今天的GPT Image 2.0,这只团团队先后解决了。画得出来、画得清楚、画得好看、画得准。

尽管近年来OpenAI的人才流动很大年夜,但OpenAI照样那个能赓续吸引各类有个性的人才,不限制专业、迎接跨界,崇奉自下而上出现式研究的公司。

从一个小团队开端,有了冲破后公司倾斜更多资本,直到改变世界。

One More Thing

曾经,GPT-4o图像生成模仿吉卜力风格生成的头像囊括了全世界。

如今GPT Image 2.0的团队成员,都把本身头像换成了这种奇脖子画风。

那么这种画风的提示词是什么?团队成员也颁布了出来

Use my photo only for identity. Redraw me as a very simple surreal Japanese sticker-style caricature: long thin neck, small deadpan face, minimal black outline, flat light coloring, almost no shading, very few facial details, simplified hair shape, lots of white space, plain white background, slightly awkward and funny. Ultratall 1:3 image.

参考链接:

发表评论 取消回复